ハイパーパラメータチューニングの効果的な戦略とテクニック

ハイパーパラメータチューニングは機械学習モデルの性能向上に欠かせない重要なプロセスです。適切な戦略とテクニックを用いることで、効果的にモデルのパフォーマンスを向上させることが可能です。

はじめに

ハイパーパラメータチューニングの重要性

ハイパーパラメータチューニングは、機械学習モデルの性能を最大限に引き出すために欠かせない重要なプロセスです。ハイパーパラメータは、モデルの学習中に固定されることのないパラメータであり、適切に調整されることでモデルの挙動や性能に大きな影響を与えます。

ハイパーパラメータチューニングを行うことで、モデルの過学習や未学習といった問題を回避し、最適な性能を発揮させることが可能となります。適切なハイパーパラメータの設定によって、モデルの収束速度や汎化能力を向上させることができます。

さらに、ハイパーパラメータチューニングは、モデルのパフォーマンスを最適化するだけでなく、計算リソースの効率的な利用やモデルの訓練時間の短縮にも貢献します。適切なハイパーパラメータの選択は、機械学習プロジェクトの成功において不可欠な要素と言えるでしょう。

ハイパーパラメータチューニングの重要性を理解し、適切な戦略とテクニックを駆使してモデルの性能を最大限に引き出すことが、データサイエンティストや機械学習エンジニアにとって重要な課題であり、常に注力すべき分野と言えます。

ハイパーパラメータの理解

ハイパーパラメータの定義

ハイパーパラメータとは、機械学習モデルの学習中に固定されることのないパラメータのことを指します。つまり、ハイパーパラメータは、モデルの挙動や性能に影響を与えるが、モデル自体からは自動的に最適な値を学習することができないパラメータです。例えば、ニューラルネットワークの学習率や決定木の深さなどがハイパーパラメータの一例です。

ハイパーパラメータの適切な設定は、モデルの性能や収束速度に大きな影響を与えます。適切なハイパーパラメータを選択することで、モデルの学習がスムーズに進み、過学習や未学習といった問題を回避することができます。

ハイパーパラメータのモデルへの影響

ハイパーパラメータは、モデルの挙動や性能に直接的な影響を与える重要な要素です。例えば、学習率が大きすぎると学習が不安定になり、収束しない可能性があります。逆に、学習率が小さすぎると学習が遅くなり、収束までの時間がかかる可能性があります。

また、決定木の深さが深すぎると過学習を引き起こし、汎化性能が低下する可能性があります。一方で、深さが浅すぎると未学習に陥り、モデルの性能が低くなる可能性があります。

ハイパーパラメータの適切な調整は、モデルの性能を最大限に引き出すために不可欠です。適切なハイパーパラメータの選択は、機械学習プロジェクトの成功において非常に重要な役割を果たします。そのため、ハイパーパラメータの影響を理解し、適切な設定を行うことが求められます。

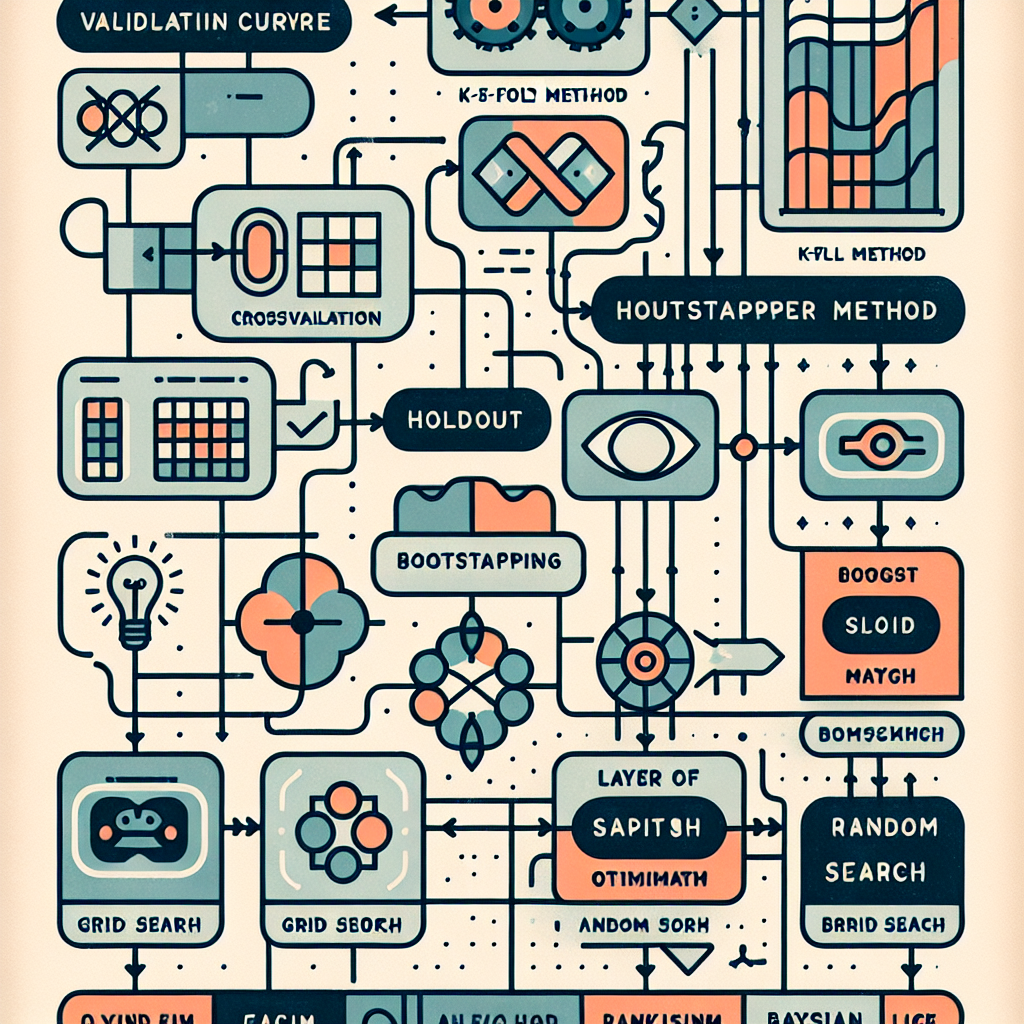

効果的なハイパーパラメータチューニングの戦略

グリッドサーチ法

グリッドサーチ法は、ハイパーパラメータチューニングにおいて広く利用される手法の一つです。この手法では、事前に定義された複数のハイパーパラメータの組み合わせをすべて試行し、最適なパラメータの組み合わせを見つけることを目指します。各パラメータの値を事前に指定した範囲内で変化させながら、全ての組み合わせを網羅的に試行するため、計算コストは高いですが、最適なハイパーパラメータを見つけやすいという利点があります。

ランダムサーチ法

ランダムサーチ法は、グリッドサーチ法の代替手法として提案されています。この手法では、ハイパーパラメータの値をランダムに選択し、その組み合わせを試行します。グリッドサーチ法と比べて計算コストが低く、ランダムな選択によって意外な最適解を見つける可能性があります。一方で、最適解を見つけるまでの試行回数が不確定であるため、収束までの時間が予測しにくいという欠点もあります。

ベイズ最適化法

ベイズ最適化法は、ハイパーパラメータチューニングにおいて効率的な手法として知られています。この手法では、過去の試行結果を元に、次に試行するハイパーパラメータの候補を確率的に選択します。ベイズ最適化法は、試行回数を最小限に抑えながら最適解に収束することができるため、計算コストを削減しつつ効率的に最適解を見つけることができます。

ハイパーパラメータチューニングのテクニック

アーリーストッピング

アーリーストッピングは、モデルの過学習を防ぐための効果的なテクニックです。通常、モデルの学習はエポック数を増やすごとに訓練データに対する誤差が減少していきますが、過学習が発生すると検証データに対する誤差が増加してしまいます。アーリーストッピングでは、検証データに対する誤差が一定期間改善されない場合に、学習を早期に停止させることで過学習を回避します。

このテクニックを用いることで、モデルの汎化性能を向上させることができます。適切なタイミングで学習を停止させることで、最適なモデルを得ることができます。

クロスバリデーション

クロスバリデーションは、モデルの汎化性能を評価するための重要なテクニックです。通常、データを訓練セットとテストセットに分割してモデルを評価しますが、この方法だとデータの偶然性によって性能評価が偏ってしまう可能性があります。クロスバリデーションでは、データを複数のグループに分割し、それぞれを交差させながら複数回のモデル評価を行うことで、より信頼性の高い性能評価を得ることができます。

このテクニックを用いることで、モデルの性能を客観的に評価し、適切なハイパーパラメータの選択やモデルの改善に役立てることができます。

アンサンブル法

アンサンブル法は、複数のモデルを組み合わせることで、単一のモデルよりも高い性能を発揮させるテクニックです。異なるモデルや同じモデルの異なるバリエーションを組み合わせることで、個々のモデルの弱点を補い、より強力な予測モデルを構築することが可能です。

アンサンブル法を用いることで、モデルの汎化性能を向上させることができます。さまざまなモデルの予測結果を組み合わせることで、より信頼性の高い予測を行うことができます。

ハイパーパラメータチューニングの評価方法

評価指標の選定

ハイパーパラメータチューニングの評価方法において、適切な評価指標の選定は非常に重要です。評価指標は、モデルの性能を客観的に評価するために用いられます。一般的な評価指標には、精度、再現率、適合率、F1スコアなどがあります。これらの指標を適切に選定することで、モデルの性能を正確に評価し、適切なハイパーパラメータの選択に役立てることができます。

評価指標の選定には、問題の性質や目標に応じて適切な指標を選ぶことが重要です。例えば、二値分類の場合は精度やROC曲線を用いることが一般的ですが、クラスの不均衡がある場合は再現率や適合率などを考慮する必要があります。適切な評価指標を選定することで、モデルの性能を適切に評価し、最適なハイパーパラメータを見つけることができます。

バリデーション曲線の解釈

ハイパーパラメータチューニングにおいて、バリデーション曲線は重要なツールとなります。バリデーション曲線は、ハイパーパラメータの値とモデルの性能の関係を可視化するために用いられます。一般的に、ハイパーパラメータの値が大きすぎるか小さすぎる場合、モデルの性能が低下する傾向が見られます。バリデーション曲線を解釈することで、適切なハイパーパラメータの範囲を特定し、最適な値を見つけることができます。

バリデーション曲線の解釈には、ハイパーパラメータの値の範囲や変化の影響を理解することが重要です。適切なハイパーパラメータの選択には、バリデーション曲線を綿密に分析し、モデルの性能を最大限に引き出すことが必要です。バリデーション曲線を正しく解釈することで、ハイパーパラメータチューニングの効果的な戦略を構築することができます。

まとめ

ハイパーパラメータチューニングは機械学習モデルの性能向上に欠かせない重要なプロセスです。適切な戦略とテクニックを使用することで、モデルのパフォーマンスを効果的に向上させることが可能です。ハイパーパラメータの適切な設定は、モデルの収束速度や汎化能力を向上させるだけでなく、計算リソースの効率的な利用やモデルの訓練時間の短縮にも貢献します。データサイエンティストや機械学習エンジニアにとって、適切なハイパーパラメータの選択とチューニングは常に注力すべき重要な課題であると言えます。

コメント